Funciones de IA¶

Turbo EA incluye funciones impulsadas por IA que utilizan un Modelo de Lenguaje Grande (LLM) para asistir a los usuarios. Todas las funciones de IA comparten una única configuración de proveedor de IA — configure una vez, úselo en todas partes.

Funciones de IA disponibles actualmente:

- Sugerencias de descripción — Generación automática de descripciones de fichas usando búsqueda web + LLM

- Análisis del portafolio — Análisis estratégico bajo demanda del portafolio de aplicaciones

Estas funcionalidades son opcionales y están completamente controladas por el administrador. Pueden ejecutarse completamente en su propia infraestructura usando una instancia local de Ollama, o conectarse a proveedores comerciales de LLM.

Cómo Funciona¶

El proceso de sugerencia de IA tiene dos pasos:

-

Búsqueda web — Turbo EA consulta un proveedor de búsqueda (DuckDuckGo, Google Custom Search o SearXNG) usando el nombre y tipo de la ficha como contexto. Por ejemplo, una ficha de tipo Aplicación llamada «SAP S/4HANA» genera una búsqueda de «SAP S/4HANA software application».

-

Extracción con LLM — Los resultados de búsqueda se envían al LLM configurado junto con un prompt del sistema adaptado al tipo. El modelo produce una descripción, una puntuación de confianza (0–100%) y lista las fuentes utilizadas.

El resultado se muestra al usuario con:

- Una descripción editable que puede revisar y modificar antes de aplicar

- Una insignia de confianza que muestra la fiabilidad de la sugerencia

- Enlaces a las fuentes para que el usuario pueda verificar la información

Proveedores de LLM Soportados¶

| Proveedor | Tipo | Configuración |

|---|---|---|

| Ollama | Autoalojado | URL del proveedor (ej., http://ollama:11434) + nombre del modelo |

| OpenAI | Comercial | Clave API + nombre del modelo (ej., gpt-4o) |

| Google Gemini | Comercial | Clave API + nombre del modelo |

| Azure OpenAI | Comercial | Clave API + URL de despliegue |

| OpenRouter | Comercial | Clave API + nombre del modelo |

| Anthropic Claude | Comercial | Clave API + nombre del modelo |

Los proveedores comerciales requieren una clave API, que se almacena cifrada en la base de datos mediante cifrado simétrico Fernet.

Proveedores de Búsqueda¶

| Proveedor | Configuración | Notas |

|---|---|---|

| DuckDuckGo | No requiere configuración | Por defecto. Sin dependencias. No necesita clave API. |

| Google Custom Search | Requiere clave API e ID de Motor de Búsqueda Personalizado | Ingrese como API_KEY:CX en el campo de URL de búsqueda. Resultados de mayor calidad. |

| SearXNG | Requiere URL de una instancia autoalojada de SearXNG | Motor de meta-búsqueda enfocado en privacidad. API JSON. |

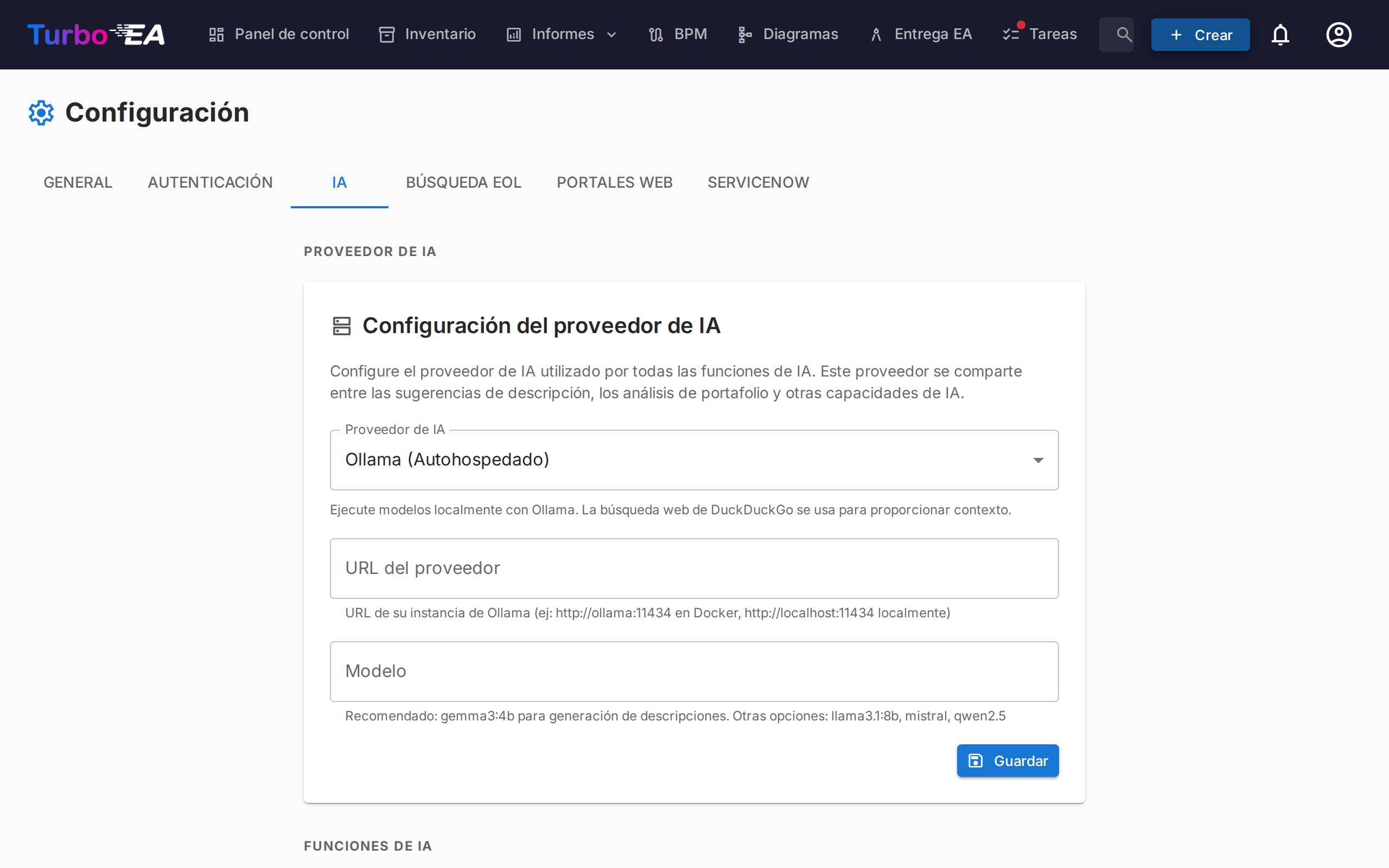

Configuración¶

Opción A: Ollama Incluido (Docker Compose)¶

La forma más sencilla de empezar. Turbo EA incluye un contenedor opcional de Ollama en su configuración de Docker Compose.

1. Inicie con el perfil de IA:

docker compose --profile ai up --build -d

2. Habilite la auto-configuración agregando estas variables a su .env:

AI_AUTO_CONFIGURE=true

AI_MODEL=gemma3:4b # o mistral, llama3:8b, etc.

Al iniciar, el backend:

- Detectará el contenedor de Ollama

- Guardará la configuración de conexión en la base de datos

- Descargará el modelo configurado si no está presente (se ejecuta en segundo plano, puede tardar unos minutos)

3. Verifique en la interfaz de administración: vaya a Configuración > Sugerencias IA y confirme que el estado muestra conectado.

Opción B: Instancia Externa de Ollama¶

Si ya ejecuta Ollama en un servidor separado:

- Vaya a Configuración > Sugerencias IA en la interfaz de administración.

- Seleccione Ollama como tipo de proveedor.

- Ingrese la URL del proveedor (ej.,

http://su-servidor:11434). - Haga clic en Probar Conexión — el sistema mostrará los modelos disponibles.

- Seleccione un modelo del menú desplegable.

- Haga clic en Guardar.

Opción C: Proveedor Comercial de LLM¶

- Vaya a Configuración > Sugerencias IA en la interfaz de administración.

- Seleccione su proveedor (OpenAI, Google Gemini, Azure OpenAI, OpenRouter o Anthropic Claude).

- Ingrese su clave API — se cifrará antes de almacenarse.

- Ingrese el nombre del modelo (ej.,

gpt-4o,gemini-pro,claude-sonnet-4-20250514). - Haga clic en Probar Conexión para verificar.

- Haga clic en Guardar.

Opciones de Configuración¶

Una vez conectado, puede ajustar la funcionalidad en Configuración > Sugerencias IA:

Habilitar/Deshabilitar por Tipo de Ficha¶

No todos los tipos de ficha se benefician por igual de las sugerencias de IA. Puede habilitar o deshabilitar la IA para cada tipo individualmente. Por ejemplo, puede habilitarla para fichas de Aplicación y Componente TI, pero deshabilitarla para fichas de Organización donde las descripciones son específicas de la empresa.

Proveedor de Búsqueda¶

Elija qué proveedor de búsqueda web usar para recopilar contexto antes de enviar al LLM. DuckDuckGo funciona sin configuración. Google Custom Search y SearXNG requieren configuración adicional (consulte la tabla de Proveedores de Búsqueda arriba).

Selección de Modelo¶

Para Ollama, la interfaz de administración muestra todos los modelos descargados en la instancia. Para proveedores comerciales, ingrese el identificador del modelo directamente.

Uso de las Sugerencias de IA¶

Una vez configurado por un administrador, los usuarios con el permiso ai.suggest (otorgado a los roles Admin, BPM Admin y Miembro por defecto) verán un botón con un destello en las páginas de detalle de fichas y en el diálogo de creación de fichas.

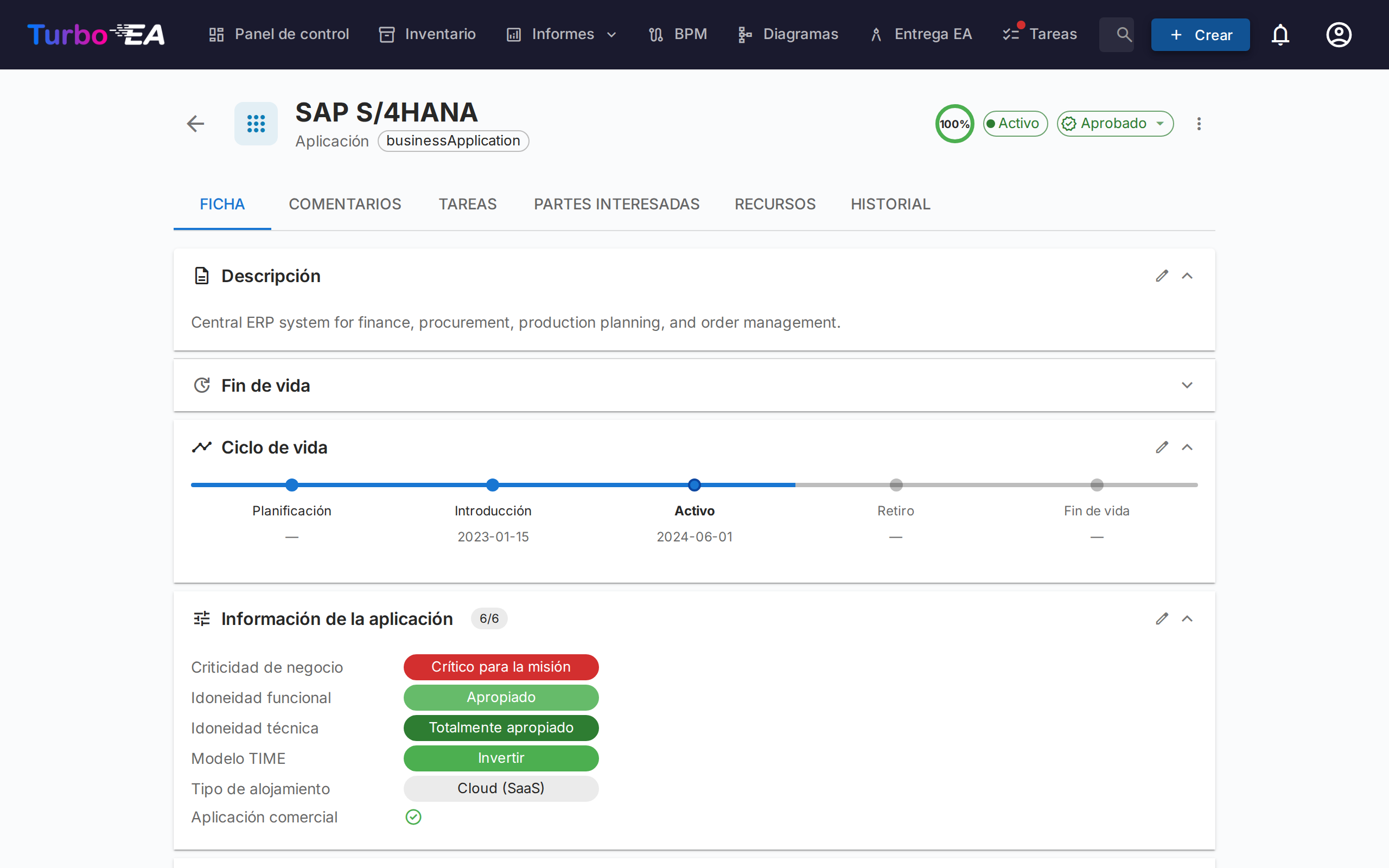

En una Ficha Existente¶

- Abra la vista de detalle de cualquier ficha.

- Haga clic en el botón de destello (visible junto a la sección de descripción cuando la IA está habilitada para ese tipo de ficha).

- Espere unos segundos mientras se realiza la búsqueda web y el procesamiento del LLM.

- Revise la sugerencia: lea la descripción generada, verifique la puntuación de confianza y consulte los enlaces a las fuentes.

- Edite el texto si es necesario — la sugerencia es completamente editable antes de aplicarla.

- Haga clic en Aplicar para establecer la descripción, o Descartar para descartarla.

Al Crear una Nueva Ficha¶

- Abra el diálogo de Crear Ficha.

- Después de ingresar el nombre de la ficha, el botón de sugerencia IA estará disponible.

- Haga clic para pre-llenar la descripción antes de guardar.

Sugerencias Específicas de Aplicación¶

Para fichas de Aplicación, la IA también puede sugerir campos adicionales cuando encuentra evidencia en los resultados de búsqueda web:

- Aplicación Comercial — se activa si se encuentran páginas de precios, información de licencias o contacto de ventas

- Tipo de Alojamiento — se sugiere como On-Premise, Cloud (SaaS), Cloud (PaaS), Cloud (IaaS) o Híbrido según el modelo de despliegue del producto

Estos campos solo se sugieren cuando la IA encuentra evidencia clara — no se especula. El usuario puede revisar y ajustar los valores antes de aplicarlos.

Note

Aparte de los campos específicos de Aplicación, las sugerencias de IA generan principalmente el campo de descripción. Los campos personalizados para otros tipos de fichas aún no están cubiertos.

Análisis del portafolio¶

Cuando está habilitado, el informe de portafolio de aplicaciones muestra un botón Análisis IA. Al hacer clic, se envía un resumen de la vista actual del portafolio — agrupación, distribuciones de atributos y datos de ciclo de vida — al LLM configurado, que devuelve de 3 a 5 análisis accionables.

Los análisis se centran en:

- Riesgos de concentración — demasiadas aplicaciones en un grupo o estado

- Oportunidades de modernización — basadas en datos de ciclo de vida y alojamiento

- Equilibrio del portafolio — diversidad en subtipos, grupos y atributos

- Preocupaciones del ciclo de vida — aplicaciones que se acercan al fin de vida

- Factores de costo o complejidad — basados en distribuciones de atributos

Habilitar análisis del portafolio¶

- Vaya a Configuración > IA > Análisis del portafolio.

- Active Análisis del portafolio.

- Haga clic en Guardar.

Permisos¶

| Rol | Acceso |

|---|---|

| Admin | Acceso completo: configurar ajustes de IA, usar sugerencias y análisis del portafolio |

| BPM Admin | Usar sugerencias y análisis del portafolio |

| Miembro | Usar sugerencias y análisis del portafolio |

| Visor | Sin acceso a funciones de IA |

Las claves de permiso son ai.suggest y ai.portfolio_insights. Los roles personalizados pueden recibir estos permisos a través de la página de administración de Roles.

Privacidad y Seguridad¶

- Opción autoalojada: Al usar Ollama, todo el procesamiento de IA ocurre en su propia infraestructura. Ningún dato sale de su red.

- Claves API cifradas: Las claves API de proveedores comerciales se cifran con cifrado simétrico Fernet antes de almacenarse en la base de datos.

- Solo contexto de búsqueda: El LLM recibe resultados de búsqueda web y el nombre/tipo de la ficha — no sus datos internos, relaciones u otros metadatos sensibles.

- Control del usuario: Cada sugerencia debe ser revisada y aplicada explícitamente por un usuario. La IA nunca modifica fichas automáticamente.

Solución de Problemas¶

| Problema | Solución |

|---|---|

| El botón de sugerencia IA no es visible | Verifique que la IA esté habilitada para el tipo de ficha en Configuración > Sugerencias IA, y que el usuario tenga el permiso ai.suggest. |

| Estado «IA no configurada» | Vaya a Configuración > Sugerencias IA y complete la configuración del proveedor. Haga clic en Probar Conexión para verificar. |

| El modelo no aparece en el menú desplegable | Para Ollama: asegúrese de que el modelo esté descargado (ollama pull nombre-modelo). Para proveedores comerciales: ingrese el nombre del modelo manualmente. |

| Sugerencias lentas | La velocidad de inferencia del LLM depende del hardware (para Ollama) o la latencia de red (para proveedores comerciales). Modelos más pequeños como gemma3:4b son más rápidos que los grandes. |

| Puntuaciones de confianza bajas | El LLM puede no encontrar suficiente información relevante mediante búsqueda web. Intente un nombre de ficha más específico, o considere usar Google Custom Search para mejores resultados. |

| La prueba de conexión falla | Verifique que la URL del proveedor sea accesible desde el contenedor del backend. Para configuraciones Docker, asegúrese de que ambos contenedores estén en la misma red. |

Variables de Entorno¶

Estas variables de entorno proporcionan la configuración inicial de IA. Una vez guardados a través de la interfaz de administración, los ajustes de la base de datos tienen prioridad.

| Variable | Por Defecto | Descripción |

|---|---|---|

AI_PROVIDER_URL |

(vacío) | URL del proveedor de LLM compatible con Ollama |

AI_MODEL |

(vacío) | Nombre del modelo LLM (ej., gemma3:4b, mistral) |

AI_SEARCH_PROVIDER |

duckduckgo |

Proveedor de búsqueda web: duckduckgo, google o searxng |

AI_SEARCH_URL |

(vacío) | URL del proveedor de búsqueda o credenciales API |

AI_AUTO_CONFIGURE |

false |

Auto-habilitar IA al iniciar si el proveedor es accesible |